2024/10/30ガバナンス

AI倫理と社内規定

AI倫理と社内規定

執筆:CISO事業部 中村 和之

昨今、企業で加速しているAI利用について、改めて著作権等の倫理規定及び企業内にて活用を進めるにあたり、倫理的観点や著作権等、また企業内での検討事項についてもまとめてみました。

AI利用については、ある一定数の仕事が奪われるとの意見や生成AIによる著作権等のリスクが取り沙汰されることが多く、最近「シンギュラリティ」等のマシンが人智を超えるような可能性について耳にすることが少なくなったように思えます。現在、テクノロジーの大転換点に差し掛かっており、AIとどのように向き合えば前向きに企業活動(ビジネス)に活かせるのか?その際、どのような社内規定及び一般的な倫理規定に沿ってふるまうべきか?といった議論が必要に思えるのですが、なんとなく耳にする機会が減った気がします。ただし、耳にする機会が減ったからといって議論自体が無くなった訳ではなく、公にAIという言葉を聞くようになる遠い昔から、AI(大規模言語モデル)の倫理や著作権問題について今もなお議論が続けられています。まず、その流れについて理解し、AIをどうすれば社会に前向きに馴染ませ、安心したビジネスへの利用へ活かせるのか?という目線に切り替える一助となればと本記事を執筆しております。

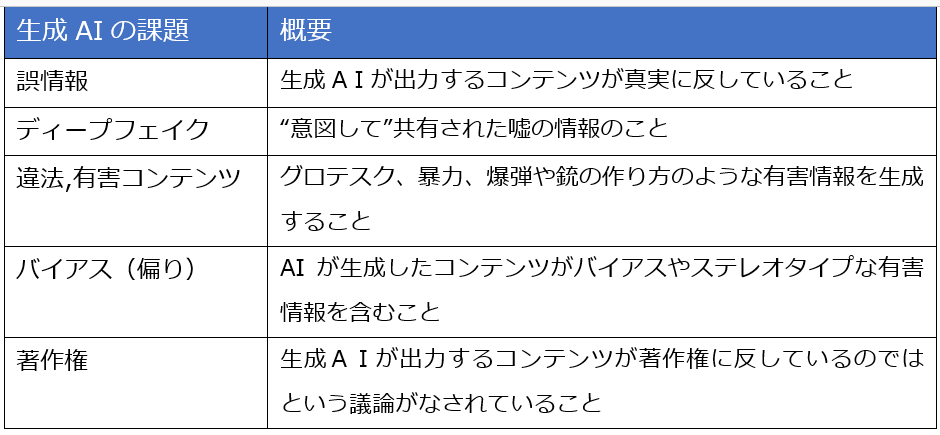

まず、AIの出現により明らかになってきたリスクとはなんでしょうか?よく挙げられるものとしては"誤情報、ディープフェイク、違法,有害コンテンツ、バイアス(偏り)、著作権"等が挙げられます。

表1.生成AIにおける主な5つの課題

出所:古川直祐/吉永京子 著「責任あるAIとルール」を基に作成(2024年5月15日 第1刷発行)

クローズドネットワークを結び、オープンネットワークが確立され、インターネットというデジタルの海が出来上がり、そこには真偽の分からない雑多なデジタルデータが投げ込まれ、1998年のGoogle設立により効率的な検索エンジンがデジタルの海を効率的に使う術を世に投げかけ、生成AIが世に出た事でデータの海を一つの意思として使う術を手に入れたと同時に、安易に,効率的に,誤情報,ディープフェイク,違法・有害コンテンツが生み出され、多種多様なバイアスや著作権の倫理的問題が世の中を混沌とさせる結果となっています。

これらの問題は、大きなテクノロジーの潮目を待っていても一向に解決しないでしょう。なぜならば、問題の本質がテクノロジーではなく利用する我々人間側にあるからです。そして、その倫理観から作り上げられた法律が現代の変化・変容を受け入れられなくなってきていることによるからです。

しかし、著作権においては「偶然、知らずに他の人の作品と似通っていた場合、著作権侵害にならない」点について、引き続き今後も多くの議論がかわされると思います。AIに関する著作権問題はほぼこの1点:依拠性において語られるからです。

では、依拠性について+AIはどの様に関わるべきかについて少し触れておきます。今後AIが社内ツールとして利便性を認知され利用が加速したタイミングで様々な議論を呼ぶと考えています。つまり、意思を持って学習用データをAIに読ませた際、もしくは具体的なアウトプットを想定して、それに近づけるために意図して特定のデータを読ませた場合でしょうか。

そこで、事業者が著作権に触れないようにするにはどのような対策があるのか?万一、著作権侵害となってしまった場合、どのような措置が課せられるのか?について少し触れておきます。

侵害への対策について

法第30 条の4においては、その"ただし書"において「当該著作物の種類及び用途並びに当該利用の態様に照らし著作権者の利益を不当に害することとなる場合は、この限りでない。」と規定し、これに該当する場合は同条が適用されないこととされている。

侵害に対する措置について

AI 学習に際して著作権侵害が生じた際に、学習を行った事業者が受け得る措置について

①享受目的が併存する、又はただし書に該当する等の理由で法第30条の4が適用されず、他の権利制限規定も適用されない場合、権利者からの許諾が得られない限り、AI学習のための複製は著作権侵害となる。

②この場合、AI学習のための複製を行った者が受け得る措置としては、損害賠償請求(民法第709条)、差止請求(侵害行為の停止又は予防の請求(法第112条第1項)、侵害の停止又は予防に必要な措置の請求(同条第2項))、刑事罰(法第119条)等が規定されている。

③なお、損害賠償請求についてはその要件として故意又は過失の存在が、刑事罰については故意の存在が必要となる。

出所:文化審議会著作権分科会法制度小委員会 著「AIと著作権に関する考え方について(素案)」を基に作成(令和6年2月29日 第1刷(素案)発行)

なーんだ"ただし書"と思われた方もいるかもしれませんが、AIにおいて参照元のデータを全て明確にするのは至難の業です。今後、テクノロジーの新化により効率化される可能性はありますが、だいぶ先の話でしょう。

今後AIのトレーニングや学習といった形で整理・加工されたデータがカスタム用としてAIに読ませるシーンが企業内でも増えてくると思います。そこで、AIエンジン(プログラム機能)の利便性のみに目が行き、読ませるデータの見極めを怠ると、後々様々な問題を引き起こしますし、今まで築き上げてきた倫理観や著作権等が蔑ろにされてしまう可能性が大いにあります。いくら社内規定を整備してもこの点においては規制,監視は難しいかもしれません。やはり、日本の教育制度自体を見直し、近い将来訪れるであろうAGI(Artificial General Intelligence)、全知全能においてAIが人類の叡智を超える時代を見据えて著作権法含めデジタル世界に対応するよう全てを作り直すくらいの覚悟を持って進める必要があるのかもしれません。国も人々も。

しかし、現時点では「生成系AI」と言われており、文章を生成するのには長けていますが、感情を持ったり思考したり自我を持つようなものではないのです。ましては、日々の意思決定に活かすことはできても、自立した意思決定は不可能という状況です。

国も重い腰を上げ、エドテック・ICT教育と現在の変化・変容を受け入れるべく教育改革に力を入れています。GIGAスクールなんかもそうでしょう。結果、インターネット(オープンネットワーク)をベースとした教育制度に移行することで、その中で上げられる問題・課題が徐々に整理され、次世代の子達へ一歩進んだ倫理観として根付ついた安全なデジタル空間へと生まれ変わるのを待つしかない気がします。法曹界でよく判断基準として用いられる「社会通念上」という観念を成長・成熟させる必要があるのかもしれません。

【プロフィール】

中村 和之(なかむら かずゆき)

2024年にデジタルアーツコンサルティング株式会社(DAC)

※2024/4よりアイディルートコンサルティング株式会社(IDR-C)へ社名変更

ヒューレットパッカード、パロアルトネットワークスを経て、ITインフラ・サイバーセキュリティの分野においてコンサルタントとして活動。最近では、多岐に渡るセキュリティ製品を顧客要件に応じて適切に組み合わせる知験作りにフォーカスした活動に注力しています。

Elizabeth Tinsley エリザベス ティンスリー(英文/スピーキング)

カリフォルニア大学 アーバイン校 仏教文化史 助教授

(University of Cambridgeにて学位取得)

https://elizabethtinsley.com/about/

アカデミックな経歴をベースに、欧州や米国、日本と日本の歴史文学・文化,芸術を新たな視点で紐解き、広める活動を行っています。